La difusión de un video falso generado con inteligencia artificial del ex presidente Mauricio Macri generó preocupación por el negativo impacto del hecho en la calidad democrática y los escasos recursos judiciales para velar por la seguridad de la ciudadanía. Sobre el tema, Radio UNNE dialogó con el abogado laboralista y docente Sebastián Ferreyra Negri; y con Naylan Faisal Marottoli, abogada experta en derecho digital y protección de datos.

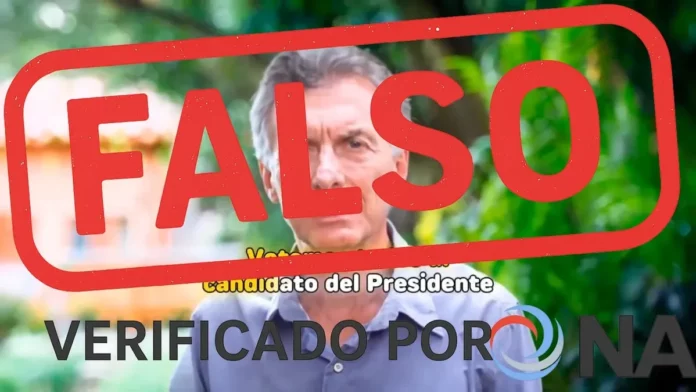

El pasado fin de semana, en contexto de veda electoral previa a las elecciones de medio término en Capital Federal, el PRO presentó una denuncia judicial por la circulación por redes sociales de un video falso generado con inteligencia artificial que simula la imagen y la voz de Mauricio Macri, donde anunciaba la supuesta baja de la candidatura de Silvia Lospennato y llamaba a votar por la lista libertaria encabezada por Manuel Adorni.

La controversia trajo debates en torno a la capacidad de respuesta de la justicia, los alcances, regulaciones e impacto del uso de la inteligencia artificial, en tiempos de desinformación y crisis institucional que aqueja a las democracias liberales en Argentina y el mundo. Específicamente en este caso se enmarca en el fenómeno de la «deepfake»: archivos audiovisuales que imitan la apariencia y voz de una persona con tal precisión que pueden engañar a las audiencias.

Ferreyra Negri, profesor de la Facultad de Derecho de la UNNE, explicó que en la producción y difusión de este tipo de material se incurrió en una serie de delitos: “Estamos en presencia de una asociación ilícita. Basta con ver las visitas de los que postearon esos videos en la Casa Rosada, basta con ver que hay un intervencionismo del propio Gobierno en esta matriz digital que incurre en una estafa a la fe pública”.

La propia denuncia del partido afectado ante el Tribunal Electoral alertaba que Argentina tiene herramientas para sancionar la inducción al voto mediante engaños y falsificaciones. En este sentido, el letrado sostuvo: “El Código Nacional es muy claro en que el clima electoral debe ser democrático y las partes deben estar comprometidas a velar por la transparencia en el proceso. Cuando aparecen noticias falsas, que al electorado le puede generar confusión, se pueden adoptar medidas cautelares como interrumpir los motores de búsqueda de Google”.

En este sentido el abogado indicó que si bien la intervención del Tribunal Electoral, que finalmente dictaminó la eliminación del material, fue adecuada por su responsabilidad en auditar el proceso, es insuficiente y señaló que la denuncia debió haberse elevado al fuero penal federal: “Estamos ante la presencia de un delito que afecta a la institucionalidad. Es tan básico y rudimentario como la época analógica, que se adulteraba información y se la publicaba en diarios de papel.”.

“Las respuestas pueden y deben ser analógicas, independientemente de la revolución disruptiva de lo digital. Hay un letargo y una no intervención del Poder Judicial, de la justicia electoral, que puede intervenir de oficio independientemente de que se interponga una denuncia”, aseveró Ferreyra Negri y manifestó preocupación por la falta de repudio por parte del resto de los espacios partidarios.

“Las noticias falsas, que son la tendencia que se viene, debe interesar a todas las fuerzas políticas, pero salieron a matarse de risa. Ese video tiene todo un metamensaje, un posicionamiento y un direccionamiento a un voto útil. Eso está craneado claramente por personas que están recibiendo fondos públicos para intereses personales. Es un momento en que se debió convocar e involucrar todo el arco electoral, si nada tiene que ocultar el candidato del oficialismo debió manifestarse también indignado con el video”, aseveró.

El docente de la UNNE manifestó preocupación por el debido proceso electoral en el presente y en el futuro del país: “Si no existen reglas justas y el comportamiento no va a ser bajo el principio de buena fe, si la trampa va a ser la vedette y nos vamos a reír del derrotado, vamos a entrar en una bajeza institucional que no recuerdo que se haya vivido en tiempos democráticos”.

“Si no existen reglas justas y el comportamiento no va a ser bajo el principio de buena fe, si la trampa va a ser la vedette y nos vamos a reír del derrotado, vamos a entrar en una bajeza institucional que no recuerdo que se haya vivido en tiempos democráticos”.

«Las leyes tiene que dar parámetros para llegar a sentencias firmes”

Faisal Marottoli, al aire de la 99.7, coincidió en reconocer la gravedad del fenómeno de la deepfake y compartió los debates en torno a la regulación de la inteligencia artificial: “La proliferación de este tipo de noticias, imágenes, videos que no se corresponda a la realidad, implica una violación de datos personales. La cara es un dato personal que necesita consentimiento para ser usado, por esto implica una vulneración a todos nuestros derechos”.

«No podemos limitar la tecnología, pero sí conducirla éticamente y crear condiciones de seguridad para los ciudadanos. El foco ahora es Macri, pero hay muchos casos de menores expuestos a estos delitos. Se hace muy fácil difamar, y hacer crecer algo que no es real”, declaró. Como abogada especializada en derecho digital, apuntó a la necesidad de regulación de la herramienta en nuestro país.

«Actualmente existe la ley de protección de datos personales, un poco desactualizada pero nos sirve; tenemos la de violencia de género digital. Estas normativas pueden contribuir, pero no hay una que diga que esto es un delito tipificable como delito penal, que incurre en la ausencia de integridad moral para los videos difundidos sin consentimiento», aseguró.

«No podemos limitar la tecnología, pero sí conducirla éticamente y crear condiciones de seguridad para los ciudadanos. El foco ahora es Macri, pero hay muchos casos de menores expuestos a estos delitos. Se hace muy fácil difamar, y hacer crecer algo que no es real”.

La abogada expuso que hay países pioneros en la tipificación de delitos de deepfakes específicamente sexuales, como España o Estados Unidos. Destacó que Australia también ha avanzado en la regulación de materiales generados por IA que afecten a la integridad de las personas. En este sentido, el trabajo interdisciplinario entre especialistas en tecnología y en derecho es un punto de partida necesario para avanzar en las regulaciones.

«Las leyes tiene que dar parámetros para llegar a sentencias firmes, pero también deben anticiparse en la prohibición de uso de materiales que manipulen o engañen deliberadamente a las personas», expresó Faisal Marottoli e instó al debate público que aborde las problemáticas internacionales desde una perspectiva local, evaluando desventajas y desventajas del control de la inteligencia artificial.